Alibaba представляет Qwen3.5 Omni: новый мультимодальный ИИ

Команда Alibaba Qwen представила Qwen3.5-Omni, новый мультимодальный языковой модель, который стал значительным шагом вперёд в эволюции технологий. Этот модель, разработанная как конкурент таким флагманским решениям, как Gemini 3.1 Pro, предлагает единый фреймворк для обработки текста, изображений, аудио и видео одновременно в рамках одной вычислительной цепочки.

Ключевой особенностью Qwen3.5-Omni является архитектура Thinker-Talker и использование гибридного механизма внимания Mixture of Experts (MoE) для всех модальностей. Это позволяет модели обрабатывать большие контекстные окна и обеспечивать взаимодействие в реальном времени без традиционных задержек, присущих каскадным системам.

Серия Qwen3.5-Omni представлена в трёх вариантах: Plus, Flash и Light, которые сбалансированы по производительности и стоимости. Модель Plus обеспечивает высокую сложность рассуждений и максимальную точность, в то время как Flash оптимизирована для высокой пропускной способности и низкой задержки взаимодействия. Light, в свою очередь, является более компактным вариантом для задач, ориентированных на эффективность.

Архитектура Thinker-Talker включает два основных компонента: Thinker и Talker. В отличие от предыдущих моделей, которые полагались на внешние предварительно обученные кодеры, Qwen3.5-Omni использует встроенный Audio Transformer (AuT) кодер, обученный на более чем 100 миллионах часов аудиовизуальных данных. Это позволяет модели лучше понимать временные и акустические нюансы, которые отсутствуют в традиционных текстовых моделях.

Qwen3.5-Omni также продемонстрировала выдающиеся результаты на глобальных рейтингах, достигнув состояния наилучшего результата (SOTA) в 215 задачах понимания аудио и аудиовизуального контента. Модель превосходит Gemini 3.1 Pro в общем понимании аудио, распознавании и переводе, достигая паритета с флагманом Google в области аудиовизуального понимания.

Для обеспечения взаимодействия в реальном времени команда Alibaba разработала технологии, такие как ARIA (Adaptive Rate Interleave Alignment), которые позволяют динамически синхронизировать текстовые и аудиовходы. Это улучшает естественность и устойчивость синтеза речи, не увеличивая задержку.

Одной из уникальных возможностей Qwen3.5-Omni является Audio-Visual Vibe Coding, которая позволяет выполнять кодирование на основе аудиовизуальных инструкций, что открывает новые горизонты для разработчиков и пользователей.

Liquid AI представила LFM2.5-350M: компактная модель с 350M параметрами

Преобразуйте AI с помощью команды Together AI

Похожие статьи

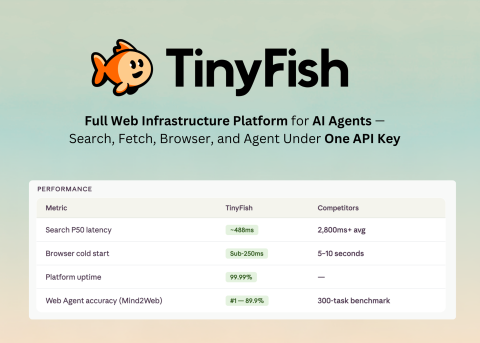

TinyFish AI запускает платформу для AI-агентов с единственным API

TinyFish AI представил платформу для AI-агентов с четырьмя инструментами и единым API.

Строим центры обработки данных в космосе для ИИ

Компании строят центры обработки данных в космосе, но реальность остается неясной.

Netflix открывает VOID: ИИ для удаления объектов из видео

Netflix представил VOID — модель ИИ, удаляющую объекты из видео с учетом физических взаимодействий.