Создайте глубоких агентов для корпоративного поиска с NVIDIA AI-Q

Хотя потребительский ИИ предлагает мощные возможности, инструменты для рабочего места часто страдают от разрозненных данных и ограниченного контекста. Созданный с использованием LangChain, шаблон NVIDIA AI-Q является открытым исходным решением, которое устраняет этот разрыв. LangChain недавно представил платформу для корпоративных агентов, разработанную с использованием ИИ от NVIDIA, для поддержки масштабируемой разработки агентов, готовых к производству. Этот учебник, доступный как запускаемый NVIDIA, показывает разработчикам, как использовать шаблон AI-Q для создания глубокого исследовательского агента, который занимает лидирующие позиции и может быть подключен к корпоративным системам.

Шаблон использует лучшие открытые и передовые языковые модели, оптимизированные с помощью набора инструментов NVIDIA NeMo Agent и контролируемые с помощью LangSmith. Результат: более быстрое время выхода на рынок для поисковых приложений, которые сохраняют бизнес-данные в безопасной среде. Шаблон NVIDIA AI-Q и набор инструментов NeMo Agent являются частью более широкого набора инструментов NVIDIA Agent Toolkit, коллекции инструментов, моделей и сред для создания, оценки и оптимизации безопасных автономных агентов.

Вы научитесь: как развернуть шаблон NVIDIA AI-Q с LangChain для корпоративных случаев использования поиска, как настраивать поверхностные и глубокие исследовательские агенты с использованием Nemotron и передовых языковых моделей, как отслеживать трассировки и производительность агентов с помощью инструментов LangSmith и NVIDIA, а также как подключать внутренние источники корпоративных данных через инструменты набора инструментов NeMo Agent.

Для доступа к открытым моделям, таким как Nemotron 3, вам потребуется ключ API NVIDIA. Ключ API Tavily позволяет выполнять веб-поиск. Следующим шагом будет сборка и запуск полного стека. Запуск нескольких контейнеров одновременно может занять несколько минут в зависимости от вашего интернет-соединения и характеристик оборудования.

После того как все службы будут работать, откройте http://localhost:3000, чтобы увидеть интерфейс AI-Q Research Assistant, где вы можете ввести исследовательский запрос и наблюдать, как агент работает в реальном времени. Шаблон AI-Q состоит как из поверхностного, так и из глубокого исследовательского агента. Поверхностный агент выполняет ограниченный цикл вызовов инструментов, тогда как глубокий агент использует LangChain для создания длинных отчетов с цитированием.

Разворачиваем раздельные нагрузки LLM на Kubernetes

Автоматизация больниц с помощью робототехники и симуляции

Похожие статьи

Модели без меток: как обучить классификатор с минимальным количеством данных

Исследование показывает, как минимальное количество меток может помочь в обучении классификатора.

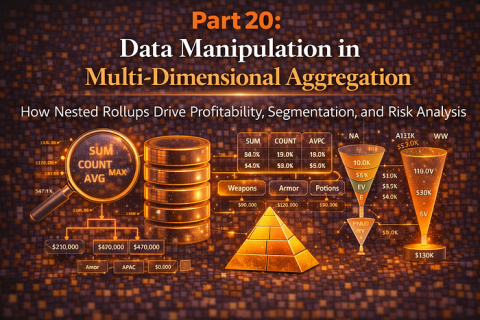

Сложные методы агрегации данных для бизнес-аналитики

Анализ сложных методов агрегации данных для бизнес-аналитики и управления рисками.

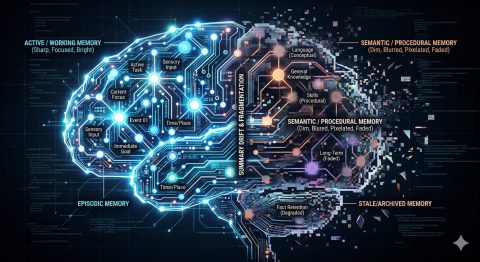

Практическое руководство по памяти для автономных агентов LLM

Изучение архитектуры памяти для автономных агентов LLM и её влияние на производительность.