Создайте «скромный» ИИ для медицины

Искусственный интеллект обещает помочь врачам в диагностике пациентов и персонализации лечения. Однако международная группа ученых под руководством MIT предупреждает, что современные ИИ-системы могут неверно направлять врачей из-за своей чрезмерной уверенности в ошибочных решениях. Один из способов избежать таких ошибок — программировать ИИ-системы так, чтобы они были более «скромными». Такие системы будут сообщать, когда они не уверены в своих диагнозах или рекомендациях, и побуждать пользователей собирать дополнительную информацию в случае неопределенности.

Лео Энтони Чели, старший научный сотрудник MIT, утверждает, что ИИ можно использовать не только как оракула, но и как тренера. Это позволит увеличить способность извлекать информацию и повысить уровень участия врачей в принятии решений. Чели и его коллеги разработали рамочную структуру, которая может помочь разработчикам ИИ создавать системы, демонстрирующие любопытство и скромность. Такой подход позволит врачам и ИИ работать в партнерстве и предотвратит чрезмерное влияние ИИ на решения врачей.

Согласно команде MIT, чрезмерно уверенные ИИ-системы могут приводить к ошибкам в медицинских учреждениях. Предыдущие исследования показали, что врачи в реанимации склонны полагаться на ИИ-системы, которые они воспринимают как надежные, даже когда их интуиция противоречит рекомендациям ИИ. Врачи и пациенты с большей вероятностью принимают неверные рекомендации ИИ, когда они воспринимаются как авторитетные.

Исследователи подчеркивают, что вместо систем, предлагающих чрезмерно уверенные, но потенциально неверные советы, медицинские учреждения должны иметь доступ к ИИ-системам, которые работают более совместно с клиницистами. Они стремятся вовлечь людей в эти системы, чтобы способствовать коллективному размышлению и переосмыслению, а не полагаться на изолированные ИИ-агенты.

Для создания такой системы консорциум разработал рамочную структуру, которая включает несколько вычислительных модулей, которые можно интегрировать в существующие ИИ-системы. Один из этих модулей требует от ИИ-модели оценивать свою уверенность при диагностических предсказаниях. Разработанный членами консорциума Эпистемический Балл Добродетели служит проверкой самосознания, обеспечивая, чтобы уверенность системы соответствовала неопределенности и сложности каждой клинической ситуации.

С этой самосознанием модель может адаптировать свои ответы к ситуации. Если система обнаруживает, что ее уверенность превышает то, что поддерживает доступная информация, она может приостановить и отметить несоответствие, запросив конкретные тесты или историю, которые разрешат неопределенность, или рекомендовать консультацию специалиста. Цель состоит в том, чтобы ИИ не только предоставлял ответы, но и сигнализировал, когда эти ответы следует воспринимать с осторожностью.

Это исследование является частью более широкой инициативы Чели и его коллег, направленной на создание ИИ-систем, разработанных с учетом людей, которые в конечном итоге будут наиболее затронуты этими инструментами. Многие модели ИИ, такие как MIMIC, обучаются на общедоступных данных из США, что может привести к введению предвзятости к определенному способу мышления о медицинских вопросах и исключению других.

Система ИИ оптимизирует движение роботов на складе

Улучшение мониторинга рыбы с помощью компьютерного зрения

Похожие статьи

Netflix открывает VOID: ИИ для удаления объектов из видео

Netflix представил VOID — модель ИИ, удаляющую объекты из видео с учетом физических взаимодействий.

Создавайте уникальные истории с помощью Flow

Создавайте уникальные истории с Flow — креативной студией на базе ИИ от Google.

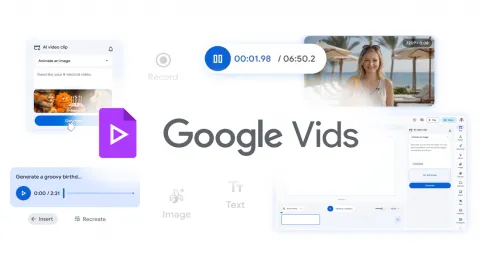

Создавайте и делитесь видео бесплатно с Google Vids

Создавайте и делитесь видео без затрат с новыми функциями Google Vids.