Как модель в 10,000 раз меньше ChatGPT обходит его по умению

В последние десять лет вся индустрия ИИ придерживалась одной неофициальной догмы: интеллект может возникнуть только в больших масштабах. Мы убеждали себя, что для того чтобы модели действительно имитировали человеческое мышление, нам нужны более крупные и глубокие сети. Это привело к созданию все более сложных трансформеров, добавлению миллиардов параметров и тренировке моделей в дата-центрах, требующих мегаватт энергии. Но не слепит ли нас эта гонка за увеличением размеров моделей от более эффективного пути? Что если истинный интеллект не связан с размером модели, а с тем, как долго она может размышлять? Может ли крошечная сеть, получившая возможность повторно обдумывать своё решение, обойти модель, в тысячи раз больше её?

Чтобы понять, почему нам нужен новый подход, необходимо взглянуть на то, почему наши текущие модели, такие как GPT-4 и Claude, всё ещё испытывают трудности с комплексной логикой. Эти модели в основном обучаются на задаче предсказания следующего токена. Они обрабатывают ввод через свои миллиардные слои, чтобы предсказать следующий токен в последовательности. Даже когда они используют метод «Цепочка Мышления», они всё равно просто предсказывают слово, что, к сожалению, не является настоящим мышлением. Этот подход имеет два недостатка. Первый заключается в его хрупкости. Поскольку модель генерирует ответы токен за токеном, одна ошибка на ранних этапах размышления может привести к совершенно другому и часто неправильному ответу. Модель не может остановиться, вернуться назад и исправить свою внутреннюю логику перед ответом. Ей нужно полностью следовать выбранному пути, часто уверенно заблуждаясь, чтобы закончить предложение. Второй проблемой является то, что современные модели рассуждения полагаются на запоминание, а не на логическое дедукцию. Они хорошо справляются с незнакомыми задачами, потому что, вероятно, уже видели похожую проблему в своих огромных обучающих данных. Но когда они сталкиваются с новыми задачами, их огромные параметры становятся бесполезными.

Модель малых рекурсий (TRM) предлагает новый подход, разбивая процесс рассуждения на компактный и циклический процесс. В отличие от традиционных трансформеров, которые требуют однократной обработки ввода для получения результата, TRM работает как рекурсивная машина с небольшим и единственным модулем MLP, который может итеративно улучшать свой вывод. Эта модель может обойти лучшие современные модели рассуждения, оставаясь при этом менее 7 миллионов параметров в размере. Чтобы понять, как эта сеть так эффективно решает задачи, давайте рассмотрим её архитектуру от ввода до решения.

В стандартных LLM единственным «состоянием» является кэш KV истории разговора. В то время как TRM поддерживает три различных информационных вектора, которые взаимно обмениваются информацией: Невозможный Вопрос (x) — оригинальная проблема, которая никогда не обновляется; Текущая Гипотеза (yt) — текущий «лучший» ответ, который обновляется вместе с моделью; Латентное Рассуждение (zn) — вектор, содержащий абстрактные «мысли» или промежуточную логику, используемую для вывода ответа. В сердце TRM находится одна маленькая нейронная сеть, которая часто имеет всего два слоя. Этот процесс рассуждения состоит из вложенного цикла, включающего два этапа: Латентное Рассуждение и Уточнение Ответа.

Сначала модель должна просто думать. Она принимает текущее состояние и запускает рекурсивный цикл для обновления своего внутреннего понимания проблемы. После завершения цикла латентного рассуждения модель пытается проецировать эти инсайты в своё состояние ответа, используя тот же механизм. Это создает мощный обратный цикл, позволяющий модели уточнять свой вывод на протяжении нескольких итераций. Таким образом, TRM демонстрирует, что меньшие модели могут быть не только эффективными, но и более интеллектуальными, если им предоставить возможность размышлять и корректировать свои ответы.

Оптимизируйте курс машинного обучения в UC Berkeley для эпохи ИИ

Salesforce обновляет Slack с 30 новыми AI-функциями

Похожие статьи

OpenAI представляет GPT-Rosalind для ускорения исследований в бионауках

OpenAI представила GPT-Rosalind, модель для ускорения исследований в бионауках.

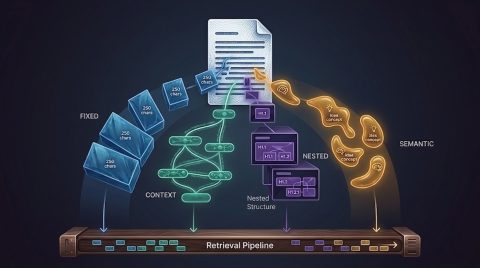

Ошибка в RAG: как неправильная сегментация данных влияет на результаты

Неправильная сегментация данных может привести к ошибкам в системе, что снижает доверие пользователей.

Google запускает новый режим AI для совместного поиска в интернете

Google представила новый режим AI для совместного поиска в интернете.