Пересмотрите управление для достижения целей в ИИ

DevOps раньше был предсказуемым: одинаковый ввод, одинаковый вывод, бинарный успех, статические зависимости, конкретные метрики. Можно было контролировать то, что можно было предсказать, измерять то, что было конкретным, и защищать то, что следовало известным шаблонам. Затем пришел агентный ИИ, и всё изменилось. Агенты действуют недетерминированно; они не следуют фиксированным шаблонам. Задайте один и тот же вопрос дважды, и получите разные ответы. Они выбирают разные инструменты и подходы в процессе работы, а не следуют заранее определённым рабочим процессам. Качество существует на градиенте от идеального до поддельного, а не в бинарном формате «пройдено-не пройдено». Предсказуемые зависимости и процессы уступили место автономным системам, которые адаптируются, рассуждают и действуют независимо.

Традиционные рамки управления ИТ, разработанные для статических развертываний, не могут справиться с этими сложными взаимодействиями многосистем. Организации сталкиваются с несогласованными уровнями безопасности в агентных рабочих процессах, с пробелами в соблюдении норм, которые варьируются в зависимости от развертывания, и с показателями наблюдаемости, которые остаются непрозрачными для бизнес-участников без глубоких технических знаний. Этот сдвиг требует переосмысления безопасности, операций и управления как взаимозависимых измерений здоровья агентной системы. Это также является исходной историей ИИ Риска Интеллекта (AIRI): автоматизированное решение для управления корпоративного уровня от AWS Generative AI Innovation Center, которое автоматизирует оценку контроля безопасности, операций и управления в единую точку зрения, охватывающую весь жизненный цикл агентных систем.

Для создания этого решения мы использовали Рамки Лучших Практик Ответственного ИИ от AWS, наши научно обоснованные рекомендации, основанные на нашем опыте с сотнями тысяч ИИ-нагрузок, помогая клиентам учитывать аспекты ответственного ИИ на протяжении всего жизненного цикла ИИ и принимать обоснованные решения по дизайну, которые ускоряют развертывание надежных систем ИИ. Рассмотрим общую угрозу безопасности в агентных системах. Open Worldwide Application Security Project (OWASP) — некоммерческая организация, отслеживающая уязвимости в кибербезопасности, определяет «Неправильное Использование Инструментов и Эксплуатацию» как одну из своих Топ-10 для Агентных Приложений в 2026 году.

Представьте, что корпоративный ИИ-ассистент имеет законный доступ к электронной почте, календарю и CRM. Злоумышленник внедряет вредоносные инструкции в электронное письмо. Пользователь запрашивает безобидное резюме, но скомпрометированный агент следует скрытым директивам — ищет конфиденциальные данные и экстрагирует их через приглашения в календаре, предоставляя при этом безобидный ответ, который маскирует нарушение. Этот непреднамеренный доступ полностью осуществляется в рамках предоставленных разрешений: ИИ-ассистент имеет право читать электронные письма, искать данные и создавать события в календаре. Стандартные инструменты предотвращения потери данных и мониторинга сетевого трафика не предназначены для оценки того, соответствуют ли действия агента его предполагаемому объему — они фиксируют аномалии в перемещении данных и сетевом трафике, ни одно из которых это непреднамеренное действие не производит.

Чтобы управлять многоагентными системами в масштабе, безопасность должна быть интегрирована непосредственно в то, как работают агенты, и наоборот. Системная природа Агентного Риска раскрывает критическое понимание: в агентных системах уязвимости безопасности каскадируют через несколько операционных измерений одновременно. Когда ИИ-ассистент неправильно использует свой календарный инструмент, нарушение каскадируется через несколько измерений: координация между агентами, управление разрешениями, человеческий контроль, видимость. Традиционные подходы, которые рассматривают безопасность, операции и управление как отдельные проблемы, создают слепые зоны именно там, где агенты координируются, обмениваются контекстом и распространяют решения.

AIRI реализует такие рамки, как Рамка Управления Рисками ИИ NIST, ISO и OWASP — преобразуя их из статических справочных документов, требующих человеческой интерпретации, в автоматизированные, непрерывные оценки, встроенные на протяжении всего жизненного цикла агентных систем, от проектирования до постпродукции. Критически важно, что AIRI является независимым от рамок: он калибруется в соответствии с стандартами управления, что означает, что один и тот же движок, который оценивает контроль безопасности OWASP, также оценивает политику организационной прозрачности или требования соблюдения, специфичные для отрасли. Это делает его применимым для различных архитектур агентов, отраслей и профилей рисков — вместо того чтобы закодировать правила для известных угроз, AIRI рассуждает на основе доказательств так, как это сделал бы аудитор, но непрерывно и в масштабе.

Теперь давайте рассмотрим, как AIRI реализует автоматизированное управление агентными системами на практике. Вернемся к примеру нашего ИИ-ассистента. Предположим, что команда разработки только что создала POC, используя этого ИИ-ассистента. Прежде чем развернуть свое решение в производстве, они запускают AIRI. Чтобы оценить основы своей системы, команда начинает с использования автоматизированной возможности проверки технической документации AIRI для автоматического сбора доказательств реализации контроля, содержащихся в таблице ниже — оценивая не только безопасность, но и качество операционного контроля: прозрачность, управляемость, объяснимость, безопасность и надежность. Анализ охватывает проектирование случая использования, инфраструктуру, обслуживающую его, и организационные политики для обеспечения соответствия корпоративным требованиям управления и соблюдения норм.

Ускорьте доставку ПО с автоматизацией QA через Amazon Nova Act

Ring оптимизирует поддержку клиентов с помощью Amazon Bedrock

Похожие статьи

Adobe представляет Firefly AI Assistant для упрощения работы с Creative Cloud

Adobe запускает Firefly AI Assistant для упрощения работы с Creative Cloud.

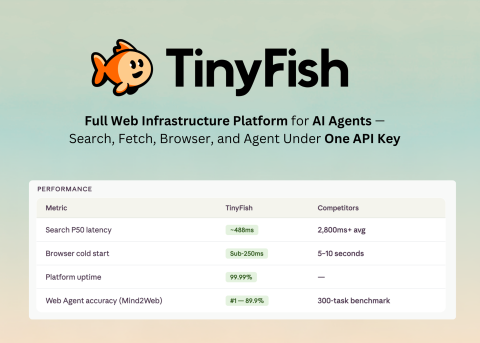

TinyFish AI запускает платформу для AI-агентов с единственным API

TinyFish AI представил платформу для AI-агентов с четырьмя инструментами и единым API.

Строим центры обработки данных в космосе для ИИ

Компании строят центры обработки данных в космосе, но реальность остается неясной.