Создайте архитектуру нулевого доверия для конфиденциальных AI-фабрик

Искусственный интеллект переходит от экспериментов к производству. Однако большинство предприятий с данными сталкиваются с тем, что их информация находится вне публичного облака. Это включает в себя чувствительные данные, такие как медицинские записи, рыночные исследования и устаревшие системы, содержащие знания предприятия. Существует также риск использования частных данных с AI-моделями, и принятие технологий часто замедляется или блокируется из-за проблем с конфиденциальностью и доверием.

Предприятия, создающие AI-фабрики следующего поколения, которые специализируются на высокопроизводительной инфраструктуре для масштабного производства интеллекта, должны строиться на основе архитектуры нулевого доверия. Эта архитектура безопасности устраняет подразумеваемое доверие к основной инфраструктуре, используя аппаратно обеспеченные доверенные исполнительные среды и криптографическую аттестацию. В данной статье описывается архитектура полного стека, необходимая для интеграции нулевого доверия в AI-фабрики.

Часто требования к локальным установкам ограничивают предприятия возможностью строить собственные модели или использовать открытые модели для агентных AI-работ. Чтобы реализовать обещание AI, организациям необходимо развернуть разнообразный набор моделей, включая собственные, на инфраструктуре, которую они контролируют, не раскрывая чувствительные данные или веса моделей администраторам, гипервизорам или операционным системам хоста.

С другой стороны, поставщики моделей требуют криптографических гарантий, что их интеллектуальная собственность не может быть извлечена, даже если она развернута вне их контролируемых сред. Конфиденциальные вычисления предоставляют такую уверенность, решая проблему доверия, которая требует подразумеваемого доверия от каждой стороны без фактической проверки доверия.

Развертывание собственных передовых моделей на общей инфраструктуре создает тройную проблему доверия среди ключевых заинтересованных сторон в AI-фабрике. Владельцы моделей должны защищать свою интеллектуальную собственность и не могут доверять, что операционная система хоста или администратор не будут просматривать или извлекать их модель. Поставщики инфраструктуры не могут доверять, что рабочая нагрузка владельца модели является безопасной, так как она может содержать вредоносный код или пытаться нарушить безопасность хоста. Владельцы данных должны гарантировать, что их чувствительные данные остаются конфиденциальными, и не могут доверять поставщику инфраструктуры или модели, что данные не будут использованы неправомерно.

Конфиденциальные вычисления решают эту проблему, обеспечивая криптографическую защиту данных и моделей на протяжении всего жизненного цикла выполнения. Конфиденциальные контейнеры (CoCo) реализуют эту технологию для Kubernetes, позволяя подам Kubernetes работать внутри аппаратно защищенных сред без необходимости переписывать приложения.

NVIDIA IGX Thor запускает промышленные и медицинские AI приложения

Разворачиваем раздельные нагрузки LLM на Kubernetes

Похожие статьи

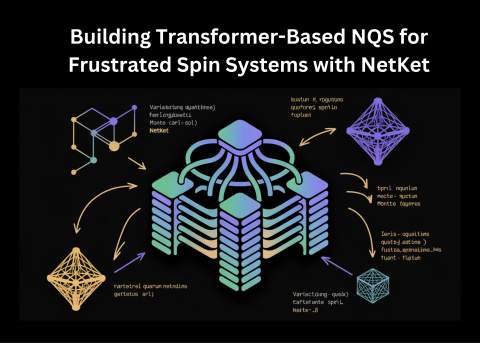

Создание нейронных квантовых состояний для фрустрированных спиновых систем

Изучение нейронных квантовых состояний для фрустрированных спиновых систем с использованием трансформеров.

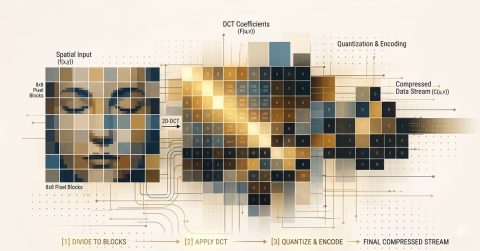

Будущее сжатия данных: от пикселей до ДНК

Будущее сжатия данных охватывает все типы информации, от геномов до видео, расширяя возможности цифровых технологий.

Сравнение ИИ между США и Китаем: разрыв в ответственности растёт

Отчет Stanford University показывает, что разрыв в производительности ИИ между США и Китаем закрылся, но проблемы с ответственностью и безопасностью остаются.