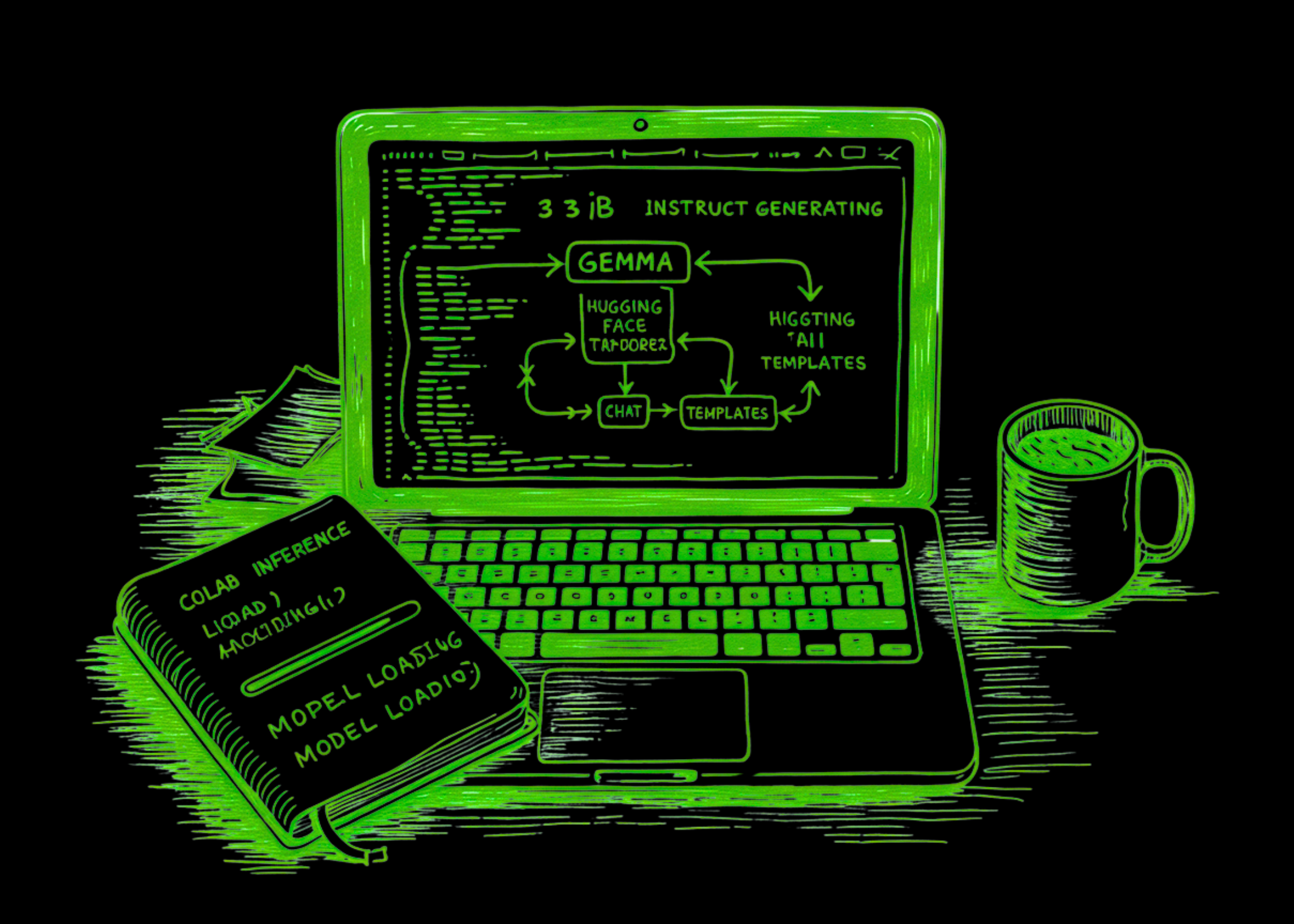

Создайте рабочий процесс Gemma 3 1B Instruct с Hugging Face

В этом руководстве мы создаем и запускаем рабочий процесс в Colab для Gemma 3 1B Instruct, используя Hugging Face Transformers и токены HF. Мы начинаем с установки необходимых библиотек, безопасной аутентификации с помощью токена Hugging Face и загрузки токенизатора и модели на доступное устройство с правильными настройками точности. Затем мы создаем повторно используемые утилиты генерации, форматируем запросы в структуре чата и тестируем модель на нескольких реалистичных задачах, таких как базовая генерация, структурированные ответы в формате JSON, цепочка запросов, бенчмаркинг и детерминированное обобщение. Таким образом, мы не просто загружаем Gemma, но и работаем с ней в значимом ключе.

Мы настраиваем окружение, необходимое для плавного выполнения руководства в Google Colab. Устанавливаем необходимые библиотеки, импортируем все основные зависимости и безопасно аутентифицируемся с Hugging Face, используя наш токен. К концу этой части мы подготовим ноутбук для доступа к модели Gemma и продолжим рабочий процесс без проблем с ручной настройкой.

Настраиваем среду выполнения, определяя, используем ли мы GPU или CPU, и выбираем соответствующую точность для эффективной загрузки модели. Затем мы определяем путь к модели Gemma 3 1B Instruct и загружаем как токенизатор, так и модель из Hugging Face. На этом этапе мы завершаем инициализацию основной модели, подготавливая ноутбук к генерации текста.

Мы создаем повторно используемые функции, которые форматируют запросы в ожидаемую структуру чата и обрабатывают генерацию текста из модели. Мы делаем конвейер вывода модульным, чтобы можно было повторно использовать ту же функцию для различных задач в ноутбуке. После этого мы запускаем первый практический пример генерации, чтобы подтвердить, что модель работает корректно и выдает значимые результаты.

Мы проверяем модель на предмет генерации структурированного вывода и цепочки запросов. Мы просим Gemma вернуть ответ в определенном формате, подобном JSON, а затем используем последующую инструкцию, чтобы преобразовать ранний ответ для другой аудитории. Это помогает нам увидеть, как модель справляется с ограничениями форматирования и многошаговой доработкой в реалистичном рабочем процессе.

Преобразуйте AI с помощью команды Together AI

DeepL: 83% компаний отстают в использовании языкового ИИ

Похожие статьи

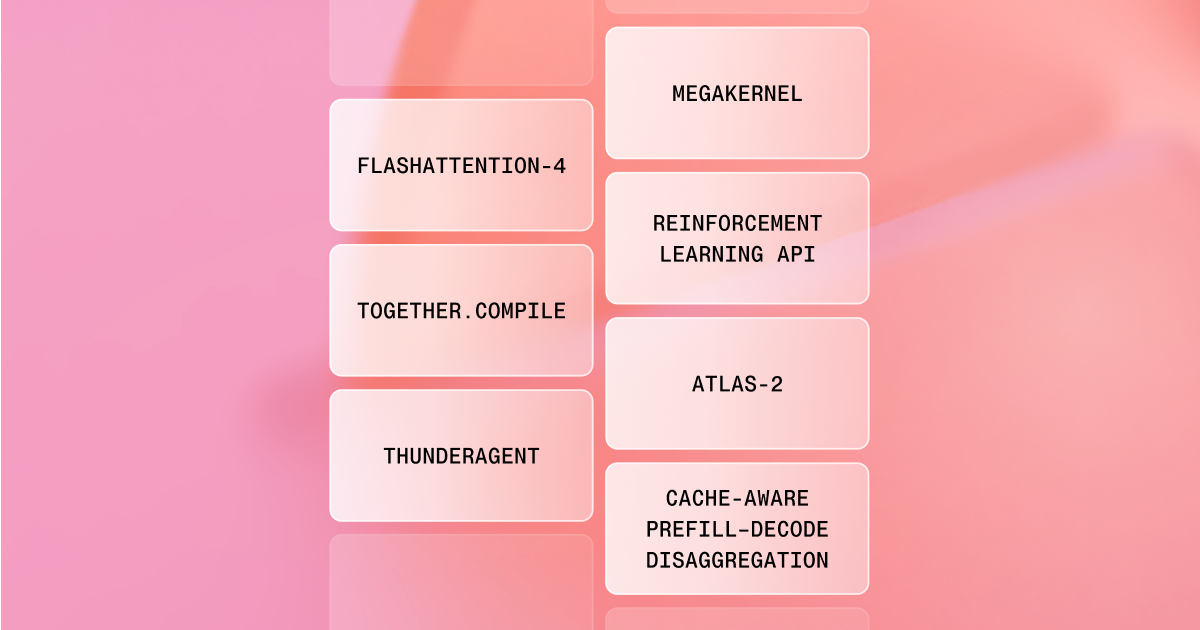

Анонсы исследований и продуктов на AI Native Conf

На AI Native Conf компания Together представила новые технологии и продукты в области AI.

Извлекайте текст из документов и изображений с Datalab Marker и OCR

Datalab представил новые инструменты для извлечения текста из документов и изображений.

Ускорьте инференс с помощью кэширования torch.compile

Кэширование torch.compile ускоряет загрузку моделей в PyTorch в 2-3 раза.