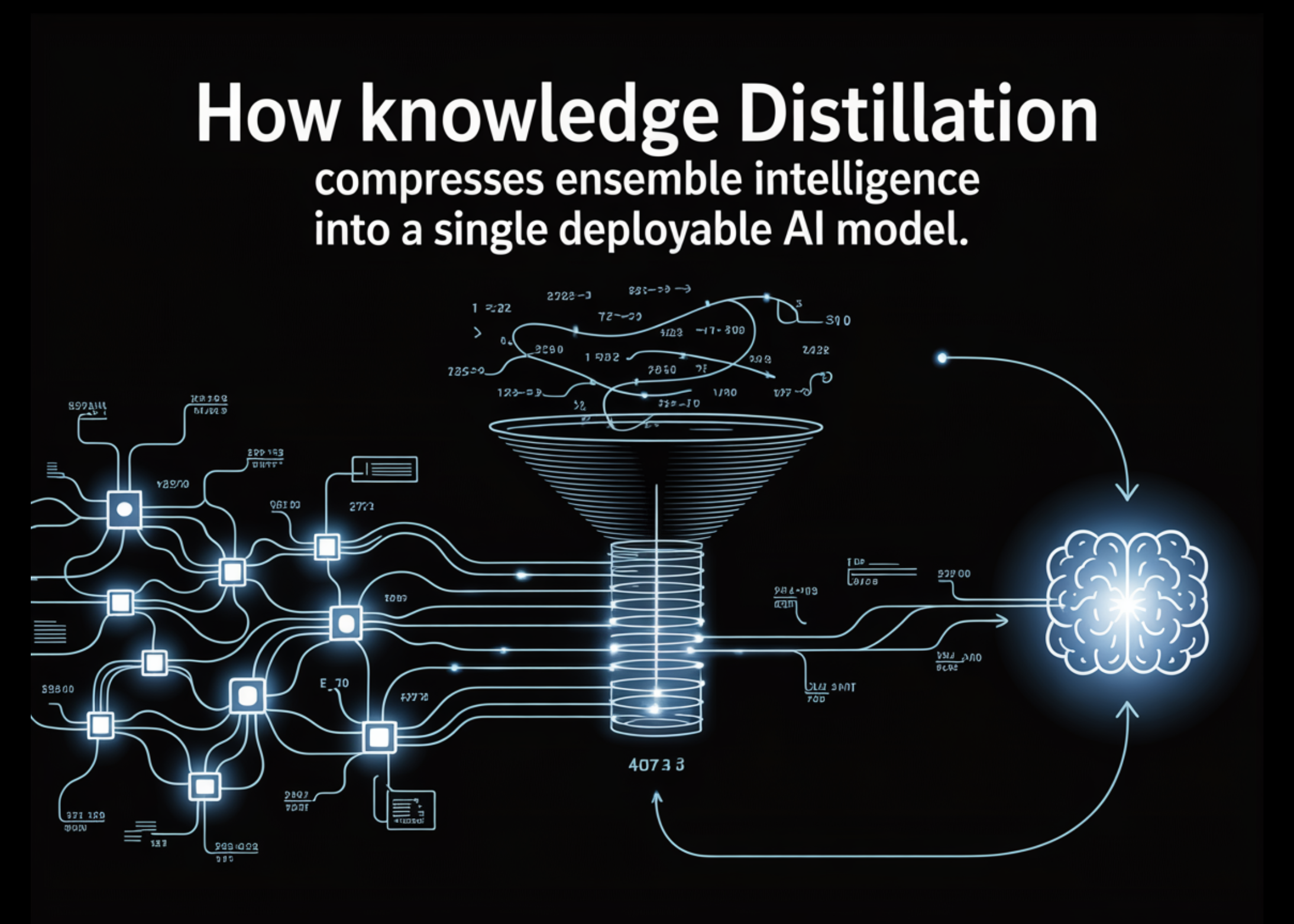

Как дистилляция знаний сжимает ансамбли в один ИИ-модель

Сложные задачи предсказания часто приводят к созданию ансамблей, так как комбинирование нескольких моделей улучшает точность за счет снижения дисперсии и захвата разнообразных паттернов. Однако такие ансамбли непрактичны для использования в производстве из-за ограничений по задержке и сложности эксплуатации. Вместо их отбраковки дистилляция знаний предлагает более умный подход: сохранить ансамбль в качестве учителя и обучить более компактную модель-студента, используя её мягкие вероятностные выходы. Это позволяет студенту унаследовать большую часть производительности ансамбля, оставаясь при этом легковесным и быстрым для развертывания.

В данной статье мы создаем этот процесс с нуля — обучаем ансамбль из 12 моделей-учителей, генерируем мягкие цели с температурным масштабированием и дистиллируем их в модель-студента, которая восстанавливает 53,8% преимущества точности ансамбля при сжатии в 160 раз. Дистилляция знаний — это техника сжатия модели, при которой большая предварительно обученная модель «учитель» передает свое поведение меньшей модели «студенту». Вместо обучения только на истинных метках, студент обучается имитировать предсказания учителя, захватывая не только конечные выходы, но и более богатые паттерны, встроенные в его вероятностные распределения.

Этот подход позволяет студенту приблизиться к производительности сложных моделей, оставаясь значительно меньшим и быстрым. Изначально разработанная для сжатия больших ансамблей в единые сети, дистилляция знаний теперь широко используется в таких областях, как обработка естественного языка, речь и компьютерное зрение, и стала особенно важной для уменьшения масштабов огромных генеративных моделей ИИ в эффективные, развертываемые системы.

В процессе мы создаем синтетический набор данных для задачи бинарной классификации, который состоит из 5000 образцов с 20 признаками, некоторые из которых являются информативными, а некоторые избыточными. Набор данных разбивается на обучающую и тестовую выборки для оценки производительности модели на невидимых данных. Далее происходит нормализация признаков, чтобы они имели единый масштаб, что помогает нейронным сетям обучаться более эффективно.

Определяются две архитектуры нейронных сетей: модель-учитель и модель-студент. Модель-учитель представляет собой одну из крупных моделей в ансамбле с несколькими слоями и широкой архитектурой, что делает её высоко выразительной, но вычислительно затратной во время вывода. Модель-студент, наоборот, является меньшей и более эффективной сетью с меньшим количеством слоев и параметров. Её цель не в том, чтобы сопоставить сложность учителя, а в том, чтобы изучить его поведение через дистилляцию.

Alibaba представляет VimRAG: новый фреймворк для многомодального RAG

Почему каждому AI-ассистенту по программированию нужна память

Похожие статьи

Создание AI-пайплайнов для компьютерного зрения с помощью DeepStream

NVIDIA DeepStream 9 упрощает создание приложений AI для компьютерного зрения.

Проблемы внедрения машинного обучения в реальных условиях

Изучение проблем внедрения машинного обучения в производственные условия и важность мониторинга.

Введение в генетические алгоритмы: ключевые компоненты и структура

Обзор ключевых компонентов генетических алгоритмов и их применения.