Alibaba представляет VimRAG: новый фреймворк для многомодального RAG

Retrieval-Augmented Generation (RAG) стал стандартной техникой для интеграции больших языковых моделей с внешними знаниями. Однако, когда речь заходит о смешивании текстов с изображениями и видео, этот подход начинает давать сбои. Исследователи из Tongyi Lab компании Alibaba представили 'VimRAG', фреймворк, разработанный специально для решения этой проблемы.

Современные RAG-агенты следуют циклу 'Мысль-Действие-Наблюдение', где агент добавляет всю историю взаимодействий в один растущий контекст. Однако для задач, связанных с видео или визуально насыщенными документами, это быстро становится непрактичным. Плотность информации критических наблюдений падает к нулю по мере увеличения шагов рассуждения. В ответ на это используется память для сжатия, где агент итеративно обобщает прошлые наблюдения в компактное состояние, что позволяет сохранить плотность информации.

В пилотном исследовании, сравнивающем различные стратегии памяти, графовая память значительно сократила количество повторных поисковых действий. В другом исследовании тестировались четыре стратегии памяти, и результаты показали, что выборочное сохранение только релевантных визуальных токенов обеспечивало наилучший компромисс между плотностью информации и точностью.

Архитектура VimRAG состоит из трех компонентов. Первый — это многомодальный граф памяти, который моделирует процесс рассуждения как динамический направленный ациклический граф. Каждый узел кодирует информацию о родительских узлах, подзапросах и визуальных токенах. Второй компонент — это кодирование визуальной памяти, которое рассматривает распределение токенов как задачу распределения ресурсов. Третий компонент — это оптимизация политики на основе графа, которая улучшает эффективность обучения, исключая из обновлений шаги, содержащие нерелевантную информацию.

VimRAG был оценен по девяти бенчмаркам, включая HotpotQA и SQuAD, и продемонстрировал высокую эффективность в сложных задачах межмодального понимания. Эта новая архитектура обещает улучшить взаимодействие с визуальными данными, что открывает новые горизонты для применения языковых моделей в сложных сценариях.

Создание пайплайна Pose2Sim для 3D кинематики без маркеров

Как дистилляция знаний сжимает ансамбли в один ИИ-модель

Похожие статьи

Google добавляет функции ИИ в Chrome для сохранения рабочих процессов

Google добавляет новую функцию Skills в Chrome для сохранения AI запросов.

Google запускает функцию персонального интеллекта Gemini в Индии

Google запускает функцию персонального интеллекта Gemini в Индии, позволяя пользователям получать персонализированные ответы.

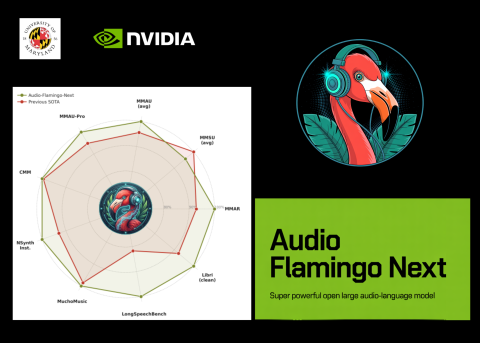

NVIDIA и Университет Мэриленда представили Audio Flamingo Next

NVIDIA и Университет Мэриленда представили Audio Flamingo Next — мощную аудио-языковую модель для обработки речи и звуков.