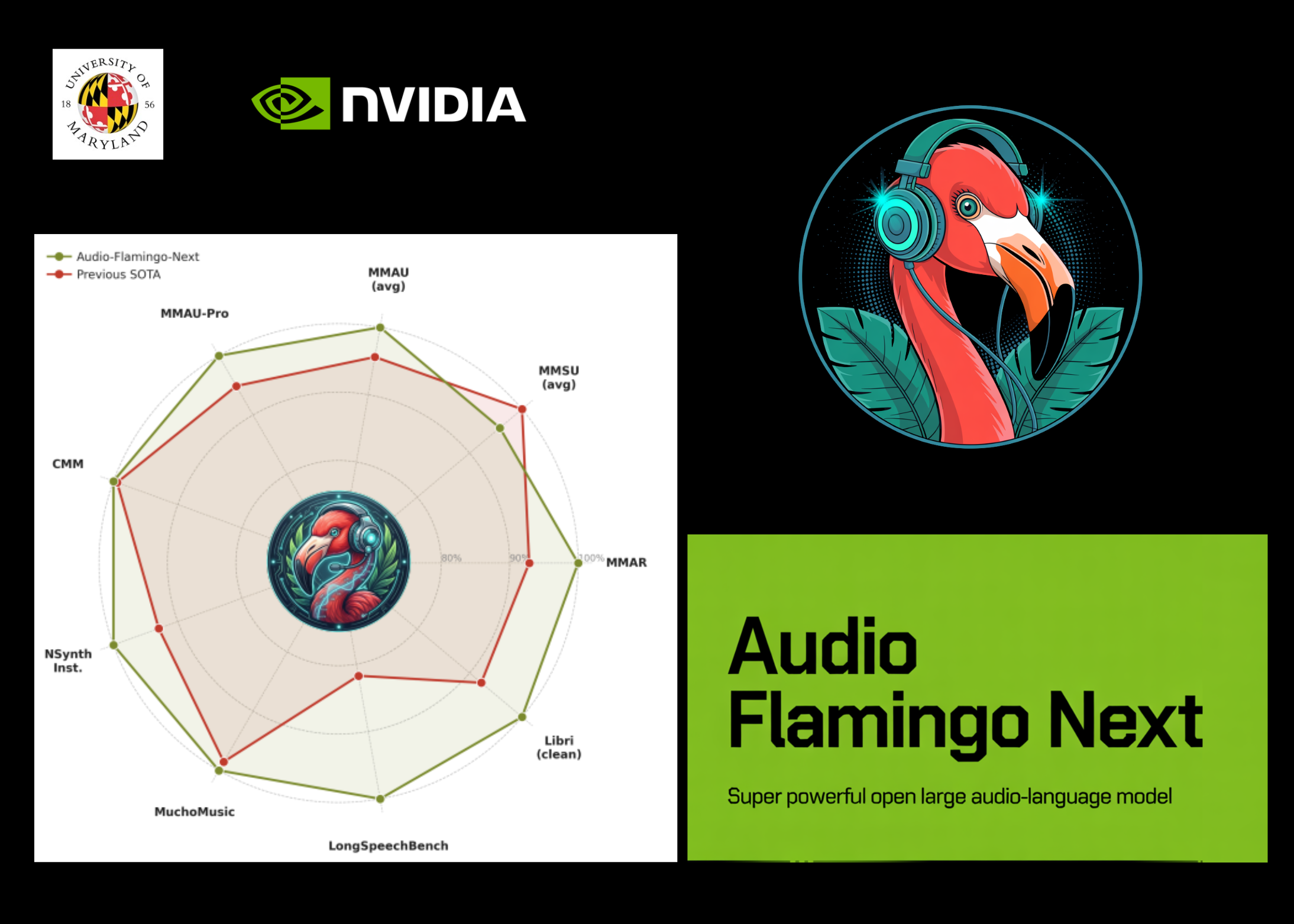

NVIDIA и Университет Мэриленда представили Audio Flamingo Next

Понимание аудио всегда было многомодальной областью, отстающей от визуальных технологий. В то время как модели изображения и языка быстро развиваются и внедряются в реальный мир, создание открытых моделей, способных надежно обрабатывать речь, окружающие звуки и музыку, особенно на больших объемах данных, остается сложной задачей. Исследователи NVIDIA и Университета Мэриленда представили Audio Flamingo Next (AF-Next), самую мощную модель в серии Audio Flamingo и полностью открытую Большую Аудио-Языковую Модель (LALM), обученную на данных аудио в масштабе интернета.

Audio Flamingo Next (AF-Next) включает три специализированные варианта для различных задач: AF-Next-Instruct для ответов на общие вопросы, AF-Next-Think для сложного многоступенчатого рассуждения и AF-Next-Captioner для детального аудиописания. Большая Аудио-Языковая Модель (LALM) сочетает аудио-кодер с языковой моделью только для декодирования, что позволяет производить ответы на вопросы, описания, транскрипцию и рассуждение непосредственно на основе аудио-входов.

AF-Next построена на четырех основных компонентах: аудио-кодере AF-Whisper, адаптере аудио, основе LLM и модуле TTS для взаимодействия «голос в голос». AF-Whisper представляет собой пользовательский кодер на основе Whisper, который дополнительно обучен на более крупном и разнообразном корпусе, включая многоязычную речь и данные ASR с несколькими говорящими. Эта модель преобразует аудиовход в мел-спектрограмму и обрабатывает его в не перекрывающихся 30-секундных блоках.

Ключевым аспектом AF-Next является использование метода Temporal Audio Chain-of-Thought, который позволяет модели привязывать каждую промежуточную мысль к временной метке в аудио, что способствует точности и снижению заблуждений при работе с длинными записями. Для обучения этой способности команда разработала набор данных AF-Think-Time, состоящий из триплетов вопрос-ответ-рассуждение, собранных из сложных аудиоматериалов.

Общий объем обучающего набора данных составляет примерно 108 миллионов образцов и около 1 миллиона часов аудио, собранного из существующих публичных наборов данных и сырого аудио из открытого интернета. Обучение проходило в четыре этапа, каждый из которых имел свои уникальные смеси данных и длины контекста. В результате получилась модель AF-Next-Captioner, а также AF-Next-Instruct и AF-Next-Think, которые были разработаны для различных задач и применения в реальных условиях.

Создание многоагентной системы анализа данных с Google ADK

Scotiabank запускает AI-рамки для оптимизации операций

Похожие статьи

Google добавляет функции ИИ в Chrome для сохранения рабочих процессов

Google добавляет новую функцию Skills в Chrome для сохранения AI запросов.

Google запускает функцию персонального интеллекта Gemini в Индии

Google запускает функцию персонального интеллекта Gemini в Индии, позволяя пользователям получать персонализированные ответы.

Пользователи сообщают о снижении производительности Claude от Anthropic

Пользователи сообщают о снижении производительности моделей Claude от Anthropic, вызывая дискуссии о качестве продукта.