MiniMax M2.7 улучшает рабочие процессы с AI на платформах NVIDIA

Выпуск MiniMax M2.7 добавляет улучшения к популярной модели MiniMax M2.5, созданной для агентных задач и других сложных сценариев в таких областях, как рассуждения, исследовательские рабочие процессы в области машинного обучения, программное обеспечение, инженерия и офисная работа.

Открытые веса MiniMax M2.7 теперь доступны через NVIDIA и в рамках экосистемы открытого исходного кода. Серия моделей MiniMax M2 представляет собой семью моделей с разреженной смесью экспертов (MoE), разработанную для повышения эффективности и возможностей. Дизайн MoE позволяет снизить затраты на вывод, сохраняя полную мощность модели с 230 миллиардами параметров.

Модель использует многоголовое причинное самообращение, улучшенное с помощью вращающих позиционных встраиваний (RoPE) и нормализации корня среднеквадратичной ошибки (QK RMSNorm) для стабильного обучения в больших масштабах. Механизм маршрутизации топ-k экспертов гарантирует, что активируются только самые релевантные эксперты для каждого конкретного ввода, что позволяет поддерживать низкие затраты на вывод, несмотря на большое количество параметров модели.

MiniMax M2.7 имеет 230 миллиардов параметров, из которых 10 миллиардов активны, а уровень активации составляет 4,3%. Длина входного контекста достигает 200 тысяч токенов. Модель включает 256 локальных экспертов, из которых 8 активируется на токен, и состоит из 62 слоев.

NVIDIA также представила NemoClaw — открытый справочный стек, который упрощает запуск всегда активных помощников OpenClaw с помощью одной команды. Он устанавливает безопасную среду для запуска автономных агентов с конечными точками или открытыми моделями, такими как M2.7. Разработчики могут начать работу с этой однокнопочной настройкой для создания среды с OpenClaw и OpenShell на платформе AI GPU от NVIDIA.

Для максимизации производительности моделей серии MiniMax M2, NVIDIA сотрудничала с сообществом открытого исходного кода для интеграции высокопроизводительных ядер в vLLM и SGLang. Эти оптимизации специально нацелены на архитектурные требования крупных моделей MoE, что позволяет значительно улучшить производительность вывода.

Ученые MIT, NVIDIA и Университета Чжэцзян предложили TriAttention для оптимизации ИИ

Liquid AI представила LFM2.5-VL-450M: новый языковый модель с поддержкой мультиязычности

Похожие статьи

Google добавляет функции ИИ в Chrome для сохранения рабочих процессов

Google добавляет новую функцию Skills в Chrome для сохранения AI запросов.

Google запускает функцию персонального интеллекта Gemini в Индии

Google запускает функцию персонального интеллекта Gemini в Индии, позволяя пользователям получать персонализированные ответы.

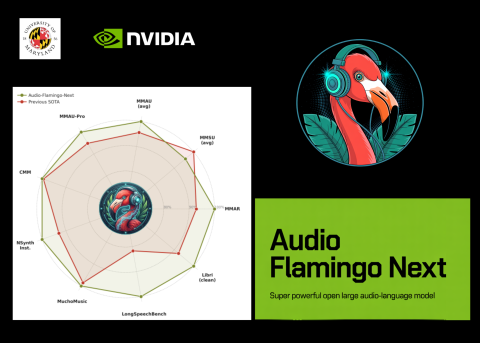

NVIDIA и Университет Мэриленда представили Audio Flamingo Next

NVIDIA и Университет Мэриленда представили Audio Flamingo Next — мощную аудио-языковую модель для обработки речи и звуков.