Qwen команда представила Qwen3.6-35B-A3B: новый открытый AI-модель

На рынке открытых AI-моделей появилось новое интересное решение. Команда Qwen компании Alibaba выпустила Qwen3.6-35B-A3B, первую модель с открытыми весами из поколения Qwen3.6, которая демонстрирует, что эффективность параметров важнее, чем просто размер модели. Эта модель содержит 35 миллиардов параметров, но активирует только 3 миллиарда во время вывода, что позволяет достигать производительности, сопоставимой с плотными моделями, в десять раз превышающими её активный размер.

Что такое модель Sparse MoE и почему это важно? Модель Mixture of Experts (MoE) не использует все свои параметры при каждом проходе. Вместо этого она направляет каждый входной токен через небольшую подгруппу специализированных подсетей, называемых «экспертами». Остальные параметры остаются неактивными. Это позволяет иметь огромное общее количество параметров, сохраняя при этом вычислительные затраты на вывод пропорциональными только активному количеству параметров.

Qwen3.6-35B-A3B является причинной языковой моделью с визуальным кодировщиком, обученной через этапы предварительного и последующего обучения. Её MoE-слой содержит 256 экспертов, из которых активируются 8 специализированных и 1 общий на токен. Архитектура включает в себя 10 блоков, каждый из которых состоит из 3 экземпляров (Gated DeltaNet → MoE) и 1 экземпляра (Gated Attention → MoE). В общей сложности 40 слоев, где подсистемы Gated DeltaNet обрабатывают линейное внимание, что является более дешевым вариантом обычного самовнимания.

Модель поддерживает нативную длину контекста в 262,144 токенов, которую можно увеличить до 1,010,000 токенов с использованием YaRN (Yet another RoPE extensioN). Важным аспектом является Agentic Coding, который демонстрирует серьезные результаты. На SWE-bench Verified, каноническом бенчмарке для решения реальных задач, Qwen3.6-35B-A3B набирает 73.4, что выше, чем у Qwen3.5-35B-A3B (70.0) и Gemma4-31B (52.0).

Модель также показывает выдающиеся результаты в области мультимодального понимания. Она способна обрабатывать изображения, документы, видео и задачи пространственного мышления. На MMMU (Massive Multi-discipline Multimodal Understanding) Qwen3.6-35B-A3B набирает 81.7, что выше, чем у Claude-Sonnet-4.5 (79.6) и Gemma4-31B (80.4). На RealWorldQA, тестирующем визуальное понимание в реальных фотографических контекстах, модель достигает 85.3, что значительно выше показателей Qwen3.5-27B (83.7) и Claude-Sonnet-4.5 (70.3).

Ключевым моментом является возможность управления поведением модели. Qwen3.6 работает в режиме мышления по умолчанию, генерируя контент, заключенный в теги

Похожие статьи

OpenAI представляет GPT-Rosalind для ускорения исследований в бионауках

OpenAI представила GPT-Rosalind, модель для ускорения исследований в бионауках.

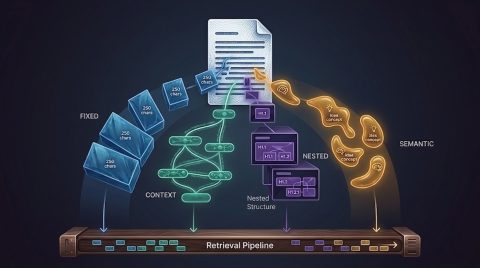

Ошибка в RAG: как неправильная сегментация данных влияет на результаты

Неправильная сегментация данных может привести к ошибкам в системе, что снижает доверие пользователей.

Google запускает новый режим AI для совместного поиска в интернете

Google представила новый режим AI для совместного поиска в интернете.