Создайте оптимизацию модели с NVIDIA Model Optimizer

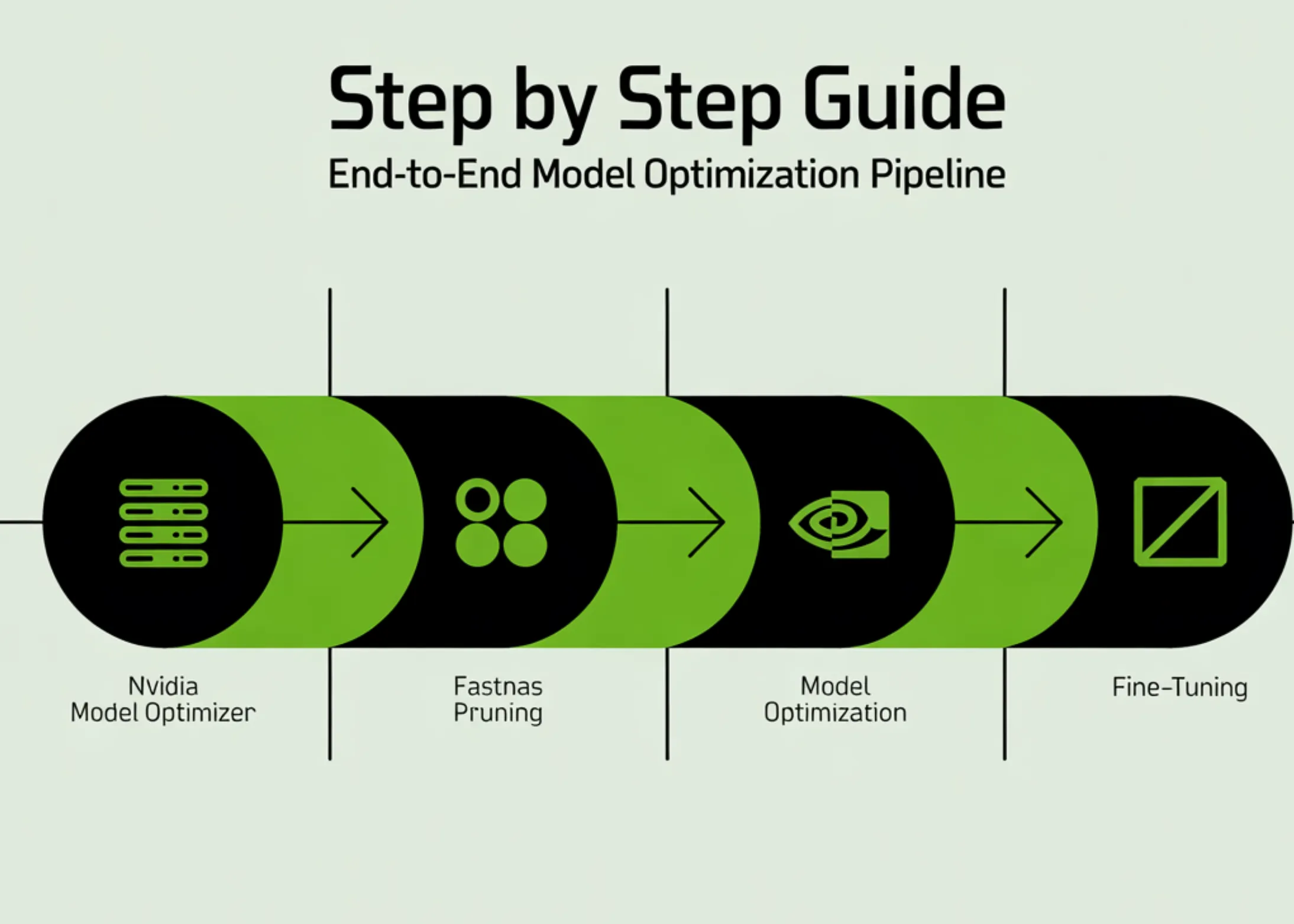

В этом руководстве мы создаем полный конвейер оптимизации модели с использованием NVIDIA Model Optimizer для обучения, обрезки и тонкой настройки глубокой модели машинного обучения прямо в Google Colab. Мы начинаем с настройки окружения и подготовки датасета CIFAR-10, затем определяем архитектуру ResNet и обучаем ее, чтобы установить надежную базу. После этого мы применяем обрезку FastNAS для систематического снижения сложности модели с учетом ограничений FLOPs, сохраняя при этом производительность.

Мы также решаем проблемы совместимости с реальным миром, восстанавливаем оптимизированную подсеть и проводим тонкую настройку для восстановления точности. В конце концов, у нас есть полностью рабочий рабочий процесс, который переводит модель от обучения к оптимизации, готовой к развертыванию, все в рамках одной упрощенной настройки.

Мы начинаем с установки всех необходимых зависимостей и импорта необходимых библиотек для настройки нашего окружения. Мы инициализируем случайные числа для обеспечения воспроизводимости и настраиваем устройство для использования GPU, если он доступен. Мы также определяем ключевые параметры выполнения, такие как размер батча, количество эпох, подмножества датасета и ограничения FLOP, чтобы контролировать общий эксперимент.

Полный конвейер данных строится путем подготовки датасетов CIFAR-10 с соответствующими аугментациями и нормализацией. Мы разбиваем датасет, чтобы уменьшить его размер и ускорить эксперименты. Затем мы создаем эффективные загрузчики данных, которые обеспечивают правильную пакетировку, перемешивание и воспроизводимое управление данными.

С помощью этого руководства пользователи смогут эффективно использовать NVIDIA Model Optimizer для создания и оптимизации своих моделей глубокого обучения, что позволит значительно улучшить производительность и ускорить процесс развертывания.

TII представляет Falcon Perception: новый трансформер для обработки изображений

Заменил векторные базы данных на память Google для заметок в Obsidian

Похожие статьи

Изучите архитектуру DenseNet и её реализацию на PyTorch

Изучите архитектуру DenseNet и её реализацию на PyTorch для решения проблемы исчезающего градиента.

Заменил векторные базы данных на память Google для заметок в Obsidian

Я заменил векторные базы данных на память Google для заметок в Obsidian, улучшив работу с воспоминаниями.

Достижение микросекундной латентности для финансовых рынков

NVIDIA достигла рекордной латентности в единичные микросекунды для моделей LSTM в финансовых рынках.