TII представляет Falcon Perception: новый трансформер для обработки изображений

В современном мире компьютерного зрения стандартный подход включает модульную архитектуру, где предобученный визуальный энкодер используется для извлечения признаков, а отдельный декодер — для предсказания задач. Хотя такой подход эффективен, он усложняет масштабирование и ограничивает взаимодействие между языком и зрением. Исследовательская команда Технологического института инноваций (TII) ставит под сомнение эту парадигму с помощью Falcon Perception — единого трансформера с 600 миллионами параметров. Обрабатывая изображения и текстовые токены в общем пространстве параметров с самого первого слоя, команда TII разработала эффективный ранний конструктор, который справляется с восприятием и моделированием задач.

Основной дизайн Falcon Perception основан на гипотезе, что один трансформер может одновременно изучать визуальные представления и выполнять генерацию, специфичную для задач. В отличие от стандартных языковых моделей, использующих строгую причинную маскировку, Falcon Perception применяет гибкую стратегию внимания. Токены изображений взаимодействуют друг с другом в обоих направлениях для создания глобального визуального контекста, в то время как текстовые и токены задач обращаются ко всем предшествующим токенам для автогрессивного предсказания. Для поддержания пространственных отношений в плоской последовательности используется 3D-ротационное позиционное кодирование, что делает модель устойчивой к изменениям ориентации и соотношения сторон.

Команда TII внедрила несколько оптимизаций для стабилизации обучения и максимизации использования GPU. Оптимизация Muon продемонстрировала более низкие потери при обучении и улучшение производительности на бенчмарках по сравнению со стандартным AdamW. Используя стратегию рассеивания и упаковки, модель обрабатывает изображения в родных разрешениях, не тратя вычислительные ресурсы на паддинг. При наличии нескольких объектов Falcon Perception предсказывает их в растрированном порядке, что позволяет быстрее достигать сходимости и снижать потери координат.

Модель использует многопрофессорское дистиллирование для инициализации, извлекая знания из DINOv3 и SigLIP2. После инициализации модель проходит через трехступенчатый тренировочный процесс, в который входят обучение контекстуальному списку, выравнивание задач и дообучение для экстремальной плотности. В этих этапах используется специфическая для задач сериализация, что заставляет модель принимать бинарные решения о существовании объектов перед их локализацией.

Для измерения прогресса команда TII представила PBench, бенчмарк, который организует образцы по пяти уровням семантической сложности. Falcon Perception значительно превосходит SAM 3 на сложных семантических задачах, особенно показывая прирост на 21.9 пункта в понимании пространства. Команда TII также расширила эту архитектуру до FalconOCR — компактной модели для распознавания символов, которая демонстрирует конкурентоспособные результаты по сравнению с крупными системами OCR.

Arcee AI запускает Trinity Large Thinking: новую открытую модель разума

Создайте оптимизацию модели с NVIDIA Model Optimizer

Похожие статьи

Google добавляет функции ИИ в Chrome для сохранения рабочих процессов

Google добавляет новую функцию Skills в Chrome для сохранения AI запросов.

Google запускает функцию персонального интеллекта Gemini в Индии

Google запускает функцию персонального интеллекта Gemini в Индии, позволяя пользователям получать персонализированные ответы.

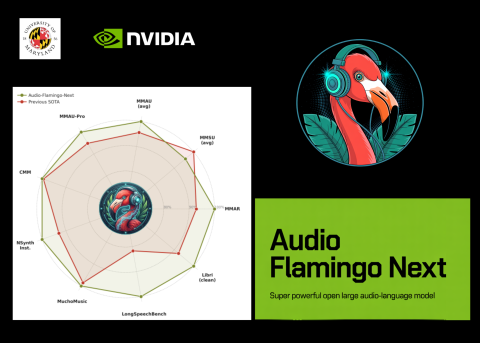

NVIDIA и Университет Мэриленда представили Audio Flamingo Next

NVIDIA и Университет Мэриленда представили Audio Flamingo Next — мощную аудио-языковую модель для обработки речи и звуков.