Изучите архитектуру DenseNet и её реализацию на PyTorch

При обучении очень глубоких нейронных сетей можно столкнуться с проблемой исчезающего градиента. Эта проблема возникает, когда обновление весов модели во время обучения замедляется или даже останавливается, что мешает улучшению модели. В случае очень глубоких сетей вычисление градиента во время обратного распространения включает в себя умножение множества производных, что может привести к крайне малым значениям. Если градиент слишком мал, обновление весов происходит медленно, и обучение затягивается.

Для решения этой проблемы можно использовать сокращенные пути, позволяющие градиентам легче проходить через глубокую сеть. Одной из самых популярных архитектур, решающих эту проблему, является ResNet, которая внедряет пропуски между несколькими слоями. Идея была усовершенствована в DenseNet, где такие соединения реализованы более агрессивно, что делает её более эффективной в борьбе с исчезающим градиентом.

Архитектура DenseNet была предложена в статье «Densely Connected Convolutional Networks» в 2016 году. Основная идея заключается в том, чтобы решить проблему исчезающего градиента. DenseNet превосходит ResNet благодаря тому, что пути сокращения исходят из одного слоя ко всем последующим слоям, что позволяет информации беспрепятственно проходить между слоями.

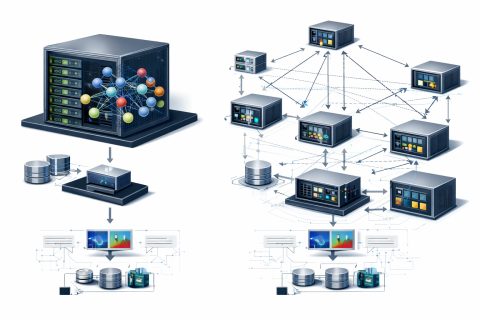

В отличие от стандартной свёрточной нейронной сети, где количество связей соответствует количеству слоёв, в DenseNet количество связей значительно больше. Например, для сети с 5 слоями будет 15 соединений, что позволяет более эффективно использовать информацию из предыдущих слоёв. Вместо элемент-wise суммирования, как в ResNet, DenseNet использует конкатенацию по каналам, что приводит к увеличению числа карт признаков по мере углубления в сеть.

Несмотря на сложные соединения, DenseNet более эффективен по сравнению с традиционными свёрточными сетями в плане количества параметров. Например, для DenseNet с 4 свёрточными слоями общее количество параметров составляет 1728, в то время как для аналогичной структуры в традиционной CNN это число превышает 7632. Таким образом, можно увидеть, что DenseNet действительно легче по сравнению с традиционными CNN благодаря механизму повторного использования признаков.

Заменил векторные базы данных на память Google для заметок в Obsidian

Компании ИИ строят газовые электростанции для дата-центров

Похожие статьи

Исследователи Meta представили гиперагенты для самообучающегося ИИ

Исследователи Meta представили гиперагенты, которые улучшают ИИ для не программируемых задач.

OpenAI обновляет SDK для агентов, чтобы помочь компаниям создавать более безопасные решения

OpenAI обновила SDK для агентов, добавив новые функции для бизнеса.

Оптимизация использования GPU для языковых моделей и снижение затрат

Оптимизация GPU для языковых моделей снижает затраты и повышает эффективность.