Создание слоя контекста для улучшения работы LLM-систем

В этой статье рассматривается создание слоя контекста, который необходим для эффективной работы систем LLM. Многие обучающие материалы по ИИ останавливаются на этапе извлечения информации или формирования подсказок, однако для реальных систем требуется дополнительный уровень, который управляет памятью, сжатием, переоценкой и лимитами токенов.

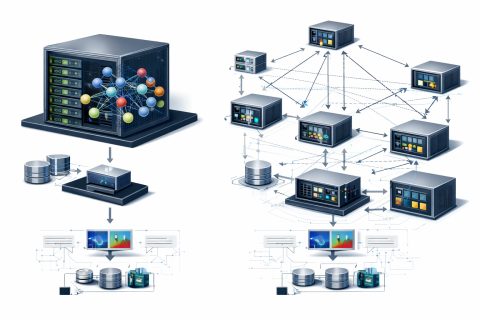

Системы RAG (Retrieval-Augmented Generation) сталкиваются с проблемами, когда контекст превышает несколько обращений. Основная проблема заключается не в извлечении информации, а в том, что на самом деле попадает в окно контекста. Слой контекста управляет тем, какая информация, в каком объеме и в каком порядке поступает в систему.

Автор статьи делится своим опытом создания системы RAG, которая работала безупречно, пока не была добавлена история разговоров. В этот момент начались сбои: релевантные документы терялись, а модель начинала забывать информацию. Эти проблемы возникают не из-за неудачи в извлечении, а из-за отсутствия контроля над тем, что попадает в окно контекста.

Для решения этих проблем необходимо внедрить архитектурный шаг между извлечением информации и созданием подсказок. Этот шаг включает в себя принятие решений о том, что модель на самом деле видит, сколько информации она получает и в каком порядке. Это называется инженерией контекста.

Архитектура, описанная в статье, полезна для разработки многоповоротных чат-ботов, систем RAG с большими базами знаний и ИИ-агентов, которым необходимо сохранять согласованность. Однако для одноразовых запросов с небольшой базой знаний такая архитектура может оказаться избыточной.

Max Hodak готовит первые испытания интерфейса для мозга человека

AWS представляет фреймворк Path-to-Value для генеративного ИИ

Похожие статьи

Исследователи Meta представили гиперагенты для самообучающегося ИИ

Исследователи Meta представили гиперагенты, которые улучшают ИИ для не программируемых задач.

OpenAI обновляет SDK для агентов, чтобы помочь компаниям создавать более безопасные решения

OpenAI обновила SDK для агентов, добавив новые функции для бизнеса.

Оптимизация использования GPU для языковых моделей и снижение затрат

Оптимизация GPU для языковых моделей снижает затраты и повышает эффективность.